Razem: 0,00 zł

W dzisiejszym, dynamicznym świecie nowych technologii, coraz więcej organizacji polega na potężnych serwerach GPU, służących do przetwarzania ogromnych zbiorów danych i realizacji wymagających obliczeniowo projektów. W tym kontekście Supermicro, renomowany producent sprzętu komputerowego, oferuje szeroką gamę serwerów, które zapewniają niezrównaną wydajność i wysoką skalowalność. W tym artykule (...)

W dzisiejszych czasach rafy koralowe są narażone na liczne zagrożenia takie jak zmiany klimatyczne, zanieczyszczenia czy degradacja środowiska. Jednak dzięki postępom w dziedzinie sztucznej inteligencji pojawiły się nowe perspektywy w walce o ich zachowanie. Jedną z inicjatyw, która wyróżnia się w tej dziedzinie, jest program NVIDIA AI for Coral Reef Conservation. NVIDIA, wraz z partnerami, (...)

Sztuczna inteligencja napędza przełomowe zmiany, odblokowując zupełnie nowe możliwości dla przedsiębiorstw we wszystkich branżach. By dokonać transformacji przy użyciu sztucznej inteligencji, przedsiębiorstwa potrzebują większej mocy obliczeniowej, większej skali i szerokiego zakresu funkcji, by sprostać wymaganiom coraz bardziej zróżnicowanych i złożonych obciążeń. Czy akcelerator obliczeniowy NVIDIA (...)

NVIDIA, przodujący dostawca technologii związanych z AI, odgrywa kluczową rolę w zapewnianiu bezpieczeństwa w dziedzinie sztucznej inteligencji. Gigant z Santa Clara nie tylko rozwija wiodące na rynku rozwiązania systemowe, ale również angażuje się we współpracę z rządem i organizacjami międzynarodowymi w celu opracowania wytycznych i standardów dotyczących bezpieczeństwa AI. W tym artykule przyjrzymy (...)

Sztuczna inteligencja znajduje dziś zastosowanie w wielu branżach, jednak pierwszym skojarzeniem z pewnością nie jest szkoła czy szeroko rozumiana branża edukacyjna. Nie zmienia to jednak faktu, że również w tym obszarze stosuje się zaawansowane rozwiązania wykorzystujące możliwości AI. W jaki sposób sztuczna inteligencja rewolucjonizuje branżę edukacyjną? Jakie korzyści niesie za sobą taka rewolucja?

Rewolucja AI przyspiesza i nic nie wskazuje na to, by miała się w najbliższym czasie zatrzymać. Wręcz przeciwnie! O wdrożeniu rozwiązań opartych na sztucznej inteligencji myślą dziś przedstawiciele niemal każdej branży. Wielu z nich już posiada takie rozwiązania, jednak planuje ich dalszy rozwój lub rozszerzenie dotychczasowego zakresu ich działania. Czym są platformy generatywnej sztucznej (...)

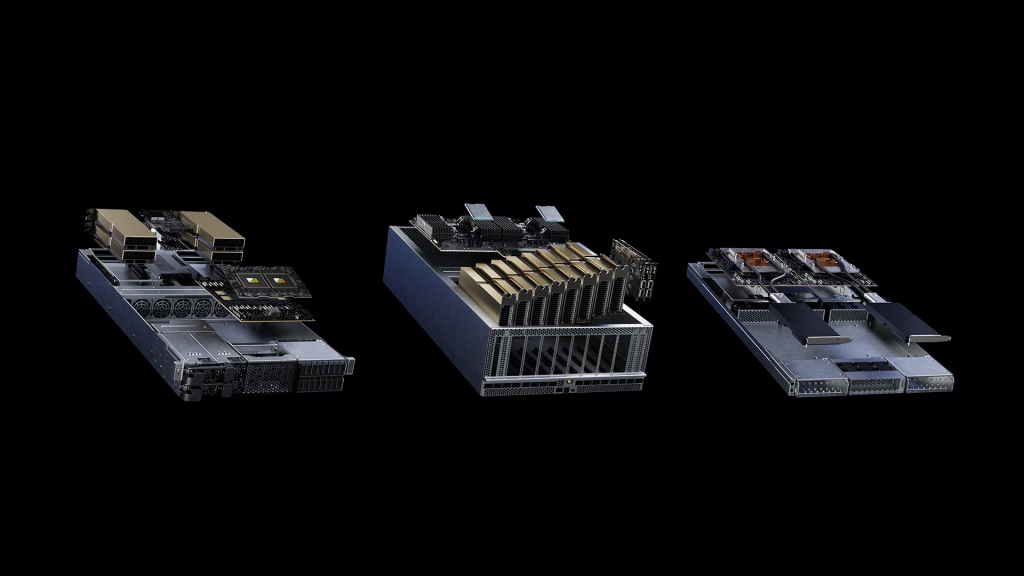

Tegoroczna edycja targów COMPUTEX zdominowana została przez NVIDIA, która zaprezentowała wiele nowości. Jedną z najbardziej interesujących premier, zwłaszcza z perspektywy klientów instytucjonalnych, poszukujących rozwiązań szytych na miarę, była niewątpliwie modułowa architektura NVIDIA MGX. Stworzono ją w odpowiedzi na dynamicznie zmieniające się potrzeby rynku i ciągle rosnąca zapotrzebowanie firm (...)

Wykładniczy wręcz rozwój sztucznej inteligencji sprawia, że wiele branż już dziś zgłasza potrzeby, którym nie są w stanie sprostać dostępne na rynku rozwiązania. Wychodząc tym oczekiwaniom naprzeciw, NVIDIA zaprezentowała właśnie swój najnowszy superkomputer – NVIDIA DGX GH200, łączący w sobie 256 superchipów NVIDIA Grace Hopper™. Stworzono go z myślą modelach klasy terabajtowej, potężnych algorytmach (...)

Rozwój technologii komputerowych takich jak wysokowydajne przetwarzanie (HPC) i zaawansowane aplikacje sztucznej inteligencji (AI), odgrywa kluczową rolę w osiąganiu postępu w wielu dziedzinach – od medycyny, przez nauki ścisłe i na branży filmowej skończywszy. Dzięki partnerstwu liderów branży: Supermicro i NVIDIA, na rynku dostępne są dziś skalowalne rozwiązania, które są w stanie sprostać rosnącemu (...)

Firmy reprezentujące najróżniejsze branże wykorzystują dziś sztuczną inteligencję do automatyzacji procesów, optymalizacji działania systemów oraz tworzenia nowych, innowacyjnych rozwiązań, które pozwalają im przetrwać na niezwykle dziś konkurencyjnym rynku. Rosnące potrzeby związane z przetwarzaniem ogromnych zbiorów danych skutkują rosnącym zapotrzebowaniem na moc obliczeniową. Z pomocą przychodzi (...)

O wdrażaniu rozwiązań, śmiało sięgających po możliwości sztucznej inteligencji, myśli coraz więcej organizacji. Coraz częściej angażują one do pracy zaawansowane modele AI przy najróżniejszych projektach. Odpowiadając na stale rosnące potrzeby biznesu, firma Supermicro sięgnęła m.in. po potężne procesory graficzne NVIDIA H100 i stworzyła niezwykle skalowalne rozwiązanie – Supermicro Rack Scale AI (...)

Przełom maja i czerwca to moment w roku, na który szczególnie czekają fani komputerów i nowoczesnej technologii. To właśnie wtedy w stolicy Tajwanu – Tajpej – odbywają się coroczne targi Computex, podczas których technologiczni liderzy już od ponad 40 lat prezentują swoje najnowsze osiągnięcia, a ich szefowie prowadzą niezwykle interesujące dyskusje i wykłady. Tegoroczna edycja targów rozpoczęła się (...)

Zastosowanie sztucznej inteligencji w motoryzacji nie jest niczym nowym. Każdy doskonale zdaje sobie sprawę z tego, że pojawienie się i rozwój autonomicznych pojazdów nie byłyby możliwe bez dynamicznego rozwoju uczenia maszynowego i maszyn zdolnych obsługiwać złożone algorytmy, analizujące w ułamkach sekund informacje pochodzące z rozlicznych czujników i sensorów. Okazuje się jednak, że jest to tylko (...)

Rozmowy z klientami nie zawsze należą do zadań łatwych. Wymagają odpowiedniego przygotowania, szerokiej wiedzy dotyczącej oferty, procedur czy aktualnych promocji, a także umiejętności szybkiego rozwiązywania problemów, z którymi mierzą się klienci. Jak właściwie odpowiadać na otrzymywane pytania? Okazuje się, że i tu z pomocą przychodzi dziś sztuczna inteligencja, która coraz częściej w czasie (...)

Po możliwości, jakie niesie za sobą wykorzystywanie sztucznej inteligencji sięgają dziś niemal wszystkie branże gospodarki. Od wielu już lat AI znajduje się w obszarze dużego zainteresowań branży medycznej, która dzięki nowoczesnym i superszybkim komputerom rewolucjonizuje sposób funkcjonowania opieki zdrowotnej, a także badanie i odkrywanie nowych leków oraz metod leczenia. Jak sztuczna inteligencja (...)

Potężny akcelerator graficzny H100, który NVIDIA zaprezentowała w ubiegłym roku, stał się jednocześnie zapowiedzią zupełnie nowej architektury – Hopper. Zgodnie z założeniem producenta stanowi on następcę akceleratora NVIDIA A100 i architektury Ampere i ma naprawdę wiele do zaoferowania. Jak bardzo NVIDIA H100 pozostawia w tyle swojego poprzednika? Co mają do zaoferowania oba akceleratory i gdzie (...)

Możliwości, jakie niesie za sobą wykorzystanie sztucznej inteligencji, są praktycznie nieograniczone. Niemal każdego dnia dowiadujemy się o kolejnym, innowacyjnym zastosowaniu AI, które już dziś zmienia lub wkrótce zmieni nasz życie na wielu różnych płaszczyznach. W jaki sposób sztuczna inteligencja pomaga w walce o ochronę środowiska naturalnego? Okazuje się, że zaawansowane algorytmy już dziś (...)

Procesory GeForce RTX 30 Series oraz GeForce RTX 40 Series to niezwykle potężne jednostki, które są w stanie sprostać oczekiwaniom najbardziej wymagających użytkowników – naukowców, grafików czy miłośników gier. Co konkretnie mają do zaoferowania jednostki wchodzące w skład każdej z serii? Na czym polegają kluczowe różnice między nimi i jak przekładają się one na jakość pracy i rozrywki użytkowników?

Wdrożenie korporacyjnych rozwiązań z zakresu sztucznej inteligencji wymaga odpowiedniego przygotowania firmowej infrastruktury. Do procesowania ogromnych wolumenów danych i zaprzęgnięcia do pracy zaawansowanych algorytmów konieczna jest niemała moc obliczeniowa. Szczególnie gdy liczy się czas i niezawodność działania. Jakie rozwiązania profesjonalnym użytkownikom oferuje dziś NVIDIA? Czym różnią się (...)

Wideo streaming pochłania zdecydowaną większość przepustowości łącza internetowego. I to nawet biorąc pod uwagę fakt, że większość treści przesyłana jest w stosunkowo niskiej rozdzielczości. Co w sytuacji, gdy użytkownik korzysta z wyświetlacza o zdecydowanie wyższej rozdzielczości? Jak działa skalowanie wideo i co do zaoferowania w tym obszarze ma NVIDIA wraz z technologią RTX Video Super Resolution?